Noticias

Facebook le responde a NYT sobre la moderación de comentarios y sus revisores de contenidos

Por @cdperiodismo

Publicado el 30 de diciembre del 2018

The New York Times reveló que Facebook ha creado una lista de lineamientos SECRETOS sobre lo que sus 2000 millones de usuarios pueden decir. El medio accedió a 1400 páginas de esas reglas, y detectó problemas en la redacción y en la manera en que se realiza el proceso de moderación.

Las reglas, advirtió NYT, contienen sesgos, omisiones y errores. Facebook respondió a las acusaciones señalando que el informe está lejos de la verdad.

«Damos la bienvenida al debate sobre cómo ayudar a mantener a Facebook como un lugar seguro donde las personas puedan expresar sus ideas. Pero ese debate debe basarse en hechos, no en caracterizaciones erróneas», se indica en el informe, donde Facebook asegura que sus políticas no son secretas: «Durante años, hemos publicado nuestros Estándares comunitarios, la guía general que describe lo que está y no está permitido en Facebook. A principios de este año , fuimos un paso más allá y publicamos las pautas internas que utilizamos para hacer cumplir esos estándares. Cualquiera puede verlos (aquí).

La red social le da la razón a The Times cuando señala que las políticas se actualizan constantemente, pero niega que el proceso sea «ad hoc»: «Realizamos cambios en nuestras políticas en función de las nuevas tendencias que ven nuestros revisores, los comentarios dentro y fuera de la empresa, así como los cambios inesperados, y a veces dramáticos, en el terreno. Y publicamos los cambios que hacemos todos los meses».

Sobre las reuniones para tomar estas medidas indicó que es u n foro global que se celebra cada dos semanas en el «que discutimos los posibles cambios en nuestras políticas. Incluye a expertos de todo el mundo con un profundo conocimiento de las leyes pertinentes, seguridad en línea, antiterrorismo, operaciones, políticas públicas, comunicaciones, productos y diversidad. Sí, los abogados y los ingenieros están presentes, pero también lo están los expertos en derechos humanos, personas que han estudiado el odio y las organizaciones extremistas, ex agentes del orden público y otros funcionarios públicos, y académicos. Como parte de este proceso, buscamos la opinión de personas fuera de Facebook para que podamos entender mejor las múltiples perspectivas de seguridad y expresión, así como el impacto de nuestras políticas en diferentes comunidades».

El mes pasado, precisa Facebook, se comenzó a publicar las actas de las reuniones y en 2019 planean incluir un registro de cambios para que las personas puedan realizar un seguimiento de las actualizaciones.

LOS MODERADORES

«El equipo responsable de la seguridad en Facebook está formado por aproximadamente 30,000 personas, de las cuales aproximadamente 15,000 son revisores de contenido en todo el mundo», precisa, pero le aclara al medio que los revisores de contenido no tienen cuotas por la cantidad de informes que deben completar. «La compensación de los revisores no se basa en la cantidad de contenido que revisan, y no se espera que nuestros revisores confíen en Google Translate, ya que reciben capacitación y recursos de apoyo», refiere Facebook.

Y dice más al respecto: «Contratamos revisores por su experiencia lingüística y contexto cultural; revisamos el contenido en más de 50 idiomas, y los alentamos a tomar el tiempo que necesiten para revisar los informes. Trabajan en más de 20 sitios en todo el mundo, que se asemejan a las propias oficinas de Facebook, y brindan soporte 24/7. Como señala el Times, algunos revisores tienen su sede en Marruecos y Filipinas, mientras que otros se basan en los Estados Unidos, Alemania, Letonia, España y otros lugares del mundo».

NYT sostiene en este punto:

«Facebook subcontrata los procesos de moderación con compañías que emplean a miles de trabajadores para hacer cumplir las reglas. En algunas de estas oficinas, los moderadores dicen que se espera que revisen muchas publicaciones en tan solo entre ocho y diez segundos. El trabajo puede ser tan exigente que muchas personas solo duran unos cuantos meses en ese cargo.

Los moderadores dicen que tienen pocos incentivos para contactar a Facebook cuando encuentran fallas en el proceso. Por su parte, Facebook permite en gran medida que las compañías que contratan a los moderadores se supervisen a sí mismas».

CASOS ESPECÍFICOS

Facebook advierte que tienen un enfoque cuidadoso en Myanmar basado en los comentarios de expertos internacionales, quienes advirtieron sobre las posibles reacciones de los militares, la culpa que se podía atribuir al gobierno y el riesgo para la seguridad de las personas en el terreno.

«Jugamos un papel importante en la forma en que las personas se comunican, y con eso surge la expectativa de que identificaremos constantemente las formas en que podemos mejorar. Así es como debería ser. Y es por eso que trabajamos constantemente con expertos de todo el mundo para escuchar sus ideas y críticas, y hacer cambios donde sea necesario», informa la red social, tras destacar que en 2018 introdujo medidas de transparencia.

Esta es la versión de Facebook.

Este es el informe de NYT.

Publicado por:

@cdperiodismo

Sígueme

COMPATIR EN REDES

NOTICIAS RELACIONADAS

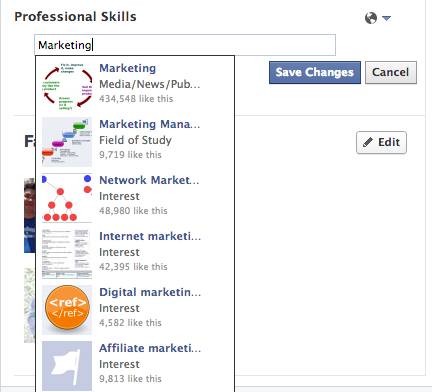

Facebook prueba espacio de “habilidades profesionales”

Facebook está experimentando nuevamente con su diseño. Esta vez se trata de la integración de una característica que tiene que ver con las habilidades profesionales de los usuarios. La opción sería similar a LinkedIn.

08-09-13

Facebook Stories se viene probando en América Latina

Facebook comenzó a probar Stories en enero en dispositivos iOS y Android en Irlanda. Los usuarios en Chile, Vietnam y Grecia ya están experimentando con este recurso.

16-03-17

NYT celebra más de un millón de suscriptores digitales

The New York Times anunció hoy que el pasado jueves 30 de julio pasó la marca de usuarios suscritos a sus contenidos exclusivamente digitales.

07-08-15